Falska minnen och äkta skapandet

Detta med AI är lite som det var med VR180 och internet samt mobiler samt TV, är hur vi överskattar ny teknik på kort tid och underskattar den på lång sikt.

För vad kan/bör AI hjälpa oss med egentligen?

Måste inleda med en aspekt av AI och sociala medier som sällan lyft fram, och det är deras påverkan i verkligheten. Ta bara det faktum att det krävdes över 700,000 liter vatten för att bara träna GTP-4, för att inte tänka på hur mycket som gått åt för den nya starkare versionen, och en vanlig konversation med ChatGPT motsvarar att hälla ut en stor flaska med färskt vatten enligt forskare från the University of Colorado Riverside och the University of Texas Arlington i deras rapport “Making AI Less ‘Thirsty.’”.

Denna mängd vatten var dessutom uträknad från att de hade använt Microsoft senaste och lästa datacenter i USA, och att om de istället hade använt något av de datacenter som finns t.ex. i Asien, så hade det krävt tre gånger så mycket vatten.

Eller en annan sida i elbristens tider – i ett arbete för att undvika stämningar för att de lagar data i Kina, så har TikTok startat upp datalagring på flera ställen i USA och i Europa.

De har t.ex. ett i Raufoss, Norge, och planerar två till i Hamar.

Detta har hindrat ett ammunitions företag beläget i samma område för att kunna öka kapaciteten för att tillverka tillräckligt med ammunition till bl.a. kriget i Ukraina. Det lokala energibolaget Elvia bekräftar dock att elnätet inte mäktar med nya fabriker sedan man utlovat elförsörjning av de nya datacenter som håller på att byggas upp.

VD:n på ammunitions företaget uttalar sig med dessa ord, som gör att trots att man förstår problematiken, samtidigt känner att så farligt är det kanske inte? 😉

– Vi är bekymrade för vi ser hur vår framtida tillväxt utmanas av lagring av kattfilmer, säger Morten Brandtzaeg, vd på Nammo till tidningen Financial Times.

Slutsats: vapen och död vs. katter och´… 🙂

Vi fortsätter lite kring det som jag skrev om tidigare i inlägget om “Ah Ej“, och vad jag själv utvecklade – samtidigt skall sägas att jag inte sett eller testat det nya AI systemet. – där jag ifrågasatte huruvida man tänkt efter ordentligt när man inom Stockholms Stad tagit fram en AI för att hjälpa jobbsökande med att skriva personliga brev.

Vem hjälper det egentligen? Den sökande? Arbetsgivaren eller de som får betalt för att hjälpa folk med att skriva egna personliga brev?

För deltagaren, hur mycket tanken en må vara – lär sig inget som sina styrkor, tror mer på sig själv eller blir stärkt på någon form i varesig lång eller kort sikt.

Samma sak för arbetsgivaren – de får något som redan nu ofta är problemet – ett underlag som inte bygger på, speglar eller motsvarar individen som de tittar på – och just därför pratar allt med rekryterande företag om hur både CV och personligt brev spelat ut sin roll. Där man istället satsar på video och gruppmöten för att konkret kunna se individernas förutsättningar – och hur mycket nytta har individen av AI-verktyget där?

Det som blir hjälpta är de som får betalt för att bidra med tid och kunskap på ett personligt plan – som nu… slipper det. Känns inte riktigt intelligent ens för Stockholms Stad som företag, då man förminskar kompetensen som man har, man över betalar de anställda för jobb som de längre inte behöver utfärda etc.

Det är just detta som är risken med AI – en okunskap och jakten på de snabba lösningarna.

Baksidan av det hela är att det som du matar in i en prompt, också lagras och lärs in av OpenAI, något som bl.a. ställde till det för Samsung där några av deras utvecklare både matat in kod för att försöka få hjälp med den samt hela mötesanteckningar för att få en sammanfattning – och där har då också allt detta läkt in och ut till OpenAI.

Säkerhetsföretaget Cyberhaven har tittat närmare på det hela och kommit fram till att hela 3,1% av alla användare har lagt in känsliga och skyddade data. Företag som Amazon, Walmart, Verizon och J.P. Morgan Chase har blockerat verktyget helt och hållet.

Vad är AI, vad är rent teknik och vad är du – Samsung gate sätter fingret på det när det avslöjades att de använde AI för att ta bilder på månen med sina smartphone… där folk blev besvikna för att de trodde att de själva tagit bilden… även om det aldrig varit så, utan det alltid varit tekniken i mobilen som gjort det.

Det finns en ny term för det: Computational photography (dvs. Beräkningsfotografering)

En tidig och enkel form av AI, som många missade – var möjligheten att dikter in texten i Microsoft Word och Google Doc. Man såg det som en ploj, och man kanske ansåg att den inte riktigt hängde med i det tempot som man höll när man talade (något som är betydligt bättre idag).

Men en funktion för det, var t.ex. att kunna träna på ett språk. Hur då? Jo, genom att t.ex. ställa in språket på franska och läsa/tala ett franskt ord eller stycke – så kunde man se om man uttalade det rätt, bra och tydligt – just genom av vilket ord som skrevs ut på skärmen. Plötsligt kunde introverta lätt faktiskt öva på att uttala, utan att någon annan lyssnade eller känna att någon annan blev irriterad för att man upprepade samma fel om och om igen.

Går vi fram i till idag, så har t.ex. två studenten på KTH, Zakarias Hedenfalk och Maximillian Claesson, tagit fram appen “nofine” som genom AI tolkar komplicerade parkeringsskyltar för att presentera ett enkelt och tydligt svar om du får stå där nu, till när och vad det kostar.

Men redan 2013 tog Tor Sjödin tillsammans med Chalmers/SAFER och i ett samarbete med professor Gunnar Karlsson från KTH (samt hade SOS International är avtalspartner), fram: IRezQ. Vilket var en uppfinning som använde sensorerna som finns i telefonen så att dessa känner av om du blir utsatt för g-krafter som är så stora så de kan tolkas som en olycka. Man behövde alltså inte som förare göra något annat än att ha appen nerladdad då den automatiskt larmade larmcentral direkt med din GPS-position och vad du har utsatts för om något skulle hända.

…samt Uppsala tjejerna Olivia Lönn, Amanda Appelberg, Sofia Grandin, Johanna Fredricsson och Sara Juto som var tidigt ute redan 2015, med sin trygghets app:

Går vi fram till idag och blickar ut över världen, så har vi bl.a. har Poised som är en AI baserad automatisk kommunikations Coach

• http://bit.ly/3KNGXXx

Problemet med tekniken är ofta inte den i sig, eller att folk inte kan den – utan att de som kan tekniken, allt för ofta är låsta i den och just därför ej ser möjligheterna.

Låt oss ta en 360 kamera t.ex. där filmar man ofta för att ta coola bilder – men man kan t.ex. använda den på möten och event samt demonstrationer etc. för att filma åt alla håll, så att man inte missar något som t.ex. händer bakom ryggen. Eller så kan man ta det ett steg längre. Tänk på alla de dokumentärer som du sett på TV om barns situation i världen. Har du tänkt att de nästan uteslutande är filmat från en höjd av vad vuxna ser?

Där finns det flera dokumentärer där man använt sig av en 360 kamera och haft den i barnens nivå – så att om du ser på den med ett virtuellt headset, så måste du själva titta upp för att se när vuxna talar och gör saker – vilket verkligen tydliggör barnens utsatthet.

Eller t.ex. så kan man använda den för att bara spela in en miljö – så att andra kan känna av och se sig runt – utan att behöva vara på plats. Lite som jag själv använt det, för introverta och dem inom NPF och autism spektrumet- så de tryckt kunde få känna av en miljö i lugn och ro, innan de tog sig till en lokal.

Det intressanta är inte hur ChatGPT tar över befintliga jobb just nu, för just kraven på autensitet och fakta kommer att vara i vägen – utan där ChatGTt funktioner kommer att glänsa är i nya yrkesroller som print engineer – för just där så handlar det om att hjälpa dig visualisera en bild i t.ex. middag och hur du både modifierar prosten och bilden för att motsvara din vision…

Att använda teknik intelligent, är faktiskt en fråga om att utmana sin egen intelligens för att tänka i nya banor.

För, tittar vi på vår egen intelligens, så kan vi se hur kroppen bygger vidare på bilder som vi ser – där hjärnan fyller i åt ögat utifrån vad vi förväntar oss, minns och tror skall vara och samma sak när den lägger ihop saker till ett minne. En enkel koppling på dessa båda är Tobe Hoopers klassiska film The Texas Chain Saw Massacre från 1974 – där vi minns bilder och scener som egentligen aldrig var där.

Vilken enkelt kan visar med en sån här bild, som kallas för Kanizsa-triangeln, efter den Italienska psykologen Gaetano Kanizsa, som tog fram den 1955 – där vi “ser” den vita triangeln som ligger över – trots att den inte finns där.

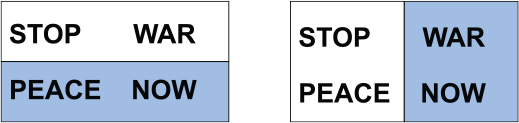

Eller denna som visar hur färger och former får oss att “självklart” se och förstå olika saker

På detta sätt så kan vi förstå att vad vi presenterar och visar upp, inte alltid är vad andra ser – då det beror på DERAS bakgrund, kunskap, igenkänning och förväntningar, vad de uppfattar.

Lite som att vi aldrig ser oss själva som andra ser oss, så vår spegelbild alltid är spegelvänd (och därav kan vi tycka vi ser ut på ett sätt i spegel, men när vi tar en bild utan spegeln – så ser det inte likadant ut. Eller att när du ser in i en spegel och rör dina ögon från höger till vänster, så kan du aldrig se hur sina ögon rör sig – vilket gör att våra visuella intryck inte är så observanta som vi tror.

Även samma sak med vår hörsel som också styrs av erfarenhet och situation – ett ljud som känns på ett sätt när man är hemma, kan kännas och upplevas på ett helt annat sätt när man är ut.

Eller t.ex. Kuleshov-effekten, skapat av den ryske filmskaparen Lev Kuleshov på 1910- och 20-talet, som skapar en mental och upplevd effekt där man klipper in en sekvens i mitten av en annan, och genom att byta ut den kan skapa olika känslor av det ursprungliga stycket.

Jag tror man får tänka lite Wikipedia – som när det kom skulle göra all kunskap tillgänglig etc., men som idag är ett av flera stopp när man sammanställer info eller bygger en grund.

För även om AI inte är en person, så bygger den på vad någon människa, eller t.o.m. apa skrivit. AI kan möjligen avväga ord utifrån dess källa- men utan att du vet känna och vägning, hur skall du kunna ta till dig resultatet?

För tro mig, om en AI tjänst samlar data från nätet, eller en specifik sajt – med tiden så kommer det komma människor med andra agendor och lägga upp material just där, enbart i syfte för att skapa kaos.

Det hela är lite som nätet kom. I början registrerade alla sig med vad de var kända som – speciellt artist… men snabbt kom någon på att Ice Cube från gruppen NWA inte hade regnat sitt namn och mängder av stora företag som var sena, så de sen fick betala skyhöga priser för att bara få en domän med sitt namn, av någon som köpt den innan de vaknat, eller se andra i början tro att det var dem som skrev olika saker..

Lite så är det idag, men det går fort – flera sci-fi novell siter som betalat för noveller har stängt ber antagandet och betalandet – då många fullt ut haft en AI att skriva den åt dem…

Intressanta dilemmat är – är det sämre bara för att det är en AI?

- Tänk t.ex. på print-on-demand tjänster för barnböcker, där du kunnat bestämma själv vad de olika karaktärerna heter…

Tänk om du kunde mata in mer från något barns liv, och få fram en makalös fantasi kring det – baksidan är väl att sex industrin också kan bygga den formen av historier samt blanda med deep fake… samt vad händer om man applicerar det på en politisk agenda?

Just för att runda av det hela, kring vilka effekter teknik och teorier samt nätet kan ha, så kommer jag att tänka på detta:

Komikern Steve Kardynal som för över ett decennium började med sina “songs in real life“. Vilket egentligen var en fortsättning på det som Bill Buchanan och Dickie Goodman skapade redan i mitten av 50-talet med sin “The Flying Saucer Parts 1 & 2” , vilket är ett av de första exemplen på Mash-ups och “sampling” samt hur Steve använda sig av Kuleshov-effekten i olika Omegle videos.

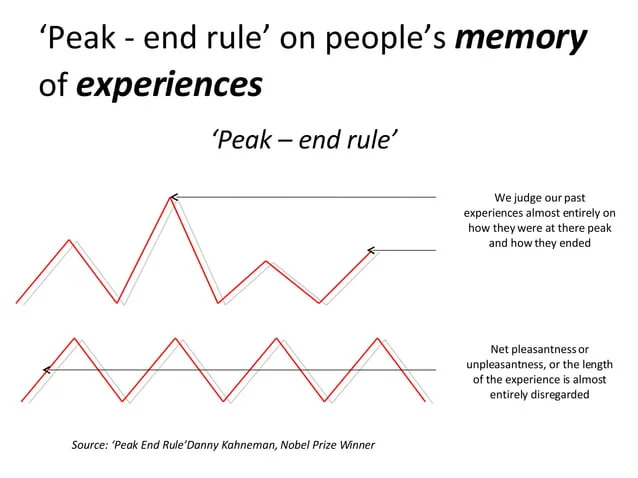

Men detta med olika psykologiska effekter och AI sammanfattas nog bäst i den s.k. The peak-end rule.

Vilket är något som Hollywood och framför allt Marvel använt sig av i efter eftertexterna – där man inte ser till att besökarna lämnar salongen med en känsla av filmens slut – utan en upphöjd förväntad på nästa del…

– Hur blir det med falska minnen och vad folk uppfattar, när vi använder AI för att skapa delar av vad som berättar om oss själva, eller om vi förlitar oss på psykologiska effekter från Storytelling, branding och marketing.

Vad landar vardagen och verkligheten i?